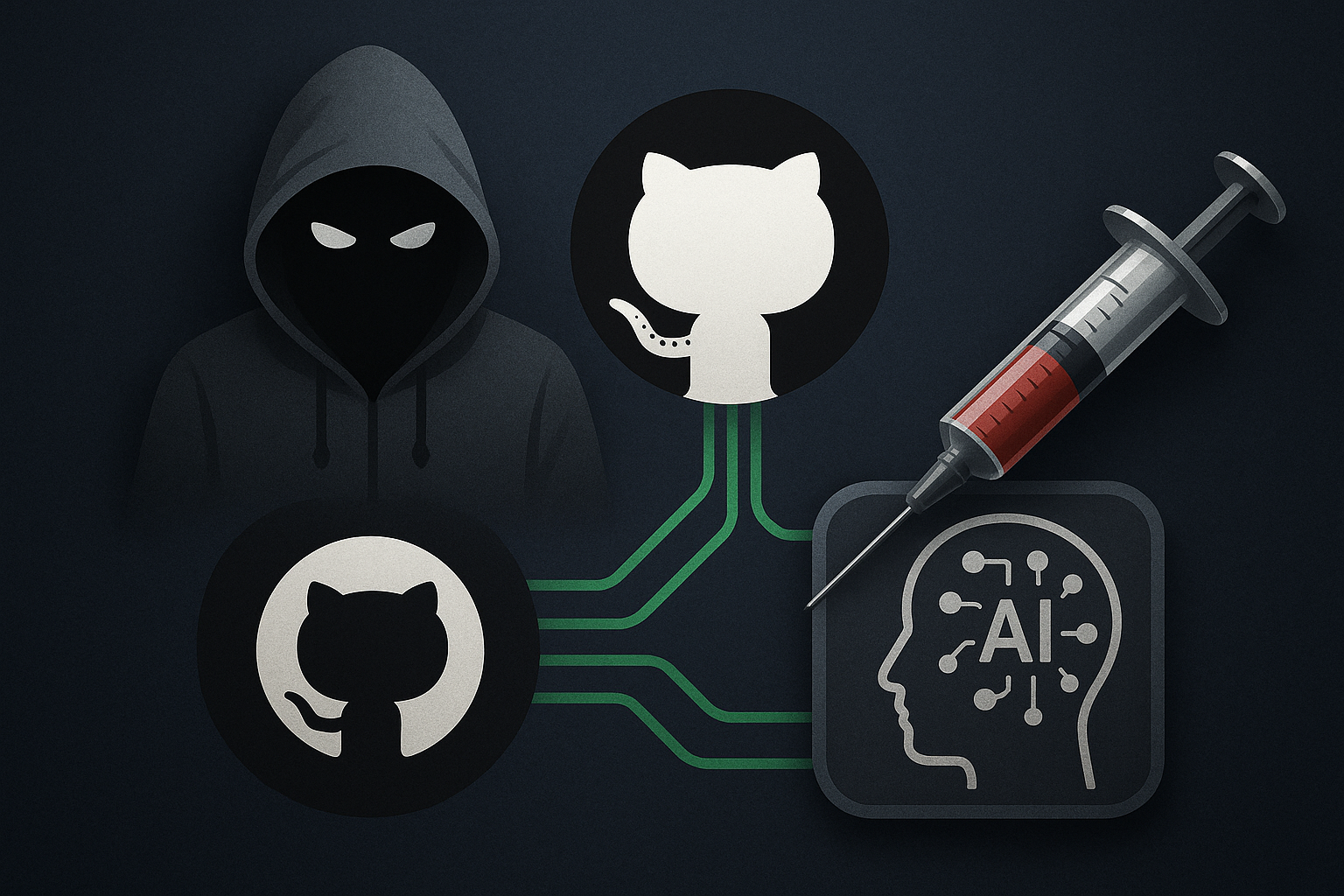

Ataque via prompt injection permite roubo de credenciais em agentes de IA integrados ao GitHub

A publicação alerta sobre um ataque de 'prompt injection' que possibilita o roubo de credenciais em agentes de inteligência artificial integrados ao GitHub. Pesquisadores demonstraram a vulnerabilidade.

Resumo rápido

Pesquisadores descobriram uma vulnerabilidade em agentes de IA integrados ao GitHub, onde um ataque de prompt injection pode roubar credenciais. Saiba como identificar e se proteger.

Neste artigo você vai aprender:

- O que é um ataque de prompt injection

- Como esses ataques funcionam

- Sinais de alerta para identificar um ataque

- Medidas de proteção contra esse tipo de ataque

- Um checklist prático para aumentar sua segurança

O que é / Contexto

O ataque de prompt injection é uma técnica onde um invasor manipula comandos de entrada para executar ações não autorizadas em sistemas de IA. Recentemente, pesquisadores identificaram que agentes de IA integrados ao GitHub são vulneráveis a esse tipo de ataque, possibilitando o roubo de credenciais de usuários.

Como funciona

O ataque ocorre quando um invasor insere comandos maliciosos em entradas de dados que são processadas por agentes de IA. Esses comandos podem fazer com que o sistema revele informações sensíveis, como credenciais de acesso, sem que o usuário perceba.

Sinais de alerta / Como identificar

Para identificar um possível ataque de prompt injection, fique atento a:

- Comportamento inesperado do agente de IA

- Solicitações de entrada de dados incomuns

- Alertas de segurança do GitHub ou outras plataformas

O que fazer agora / Como se proteger

Para se proteger contra ataques de prompt injection, é importante:

- Implementar validação rigorosa de entradas de dados

- Monitorar logs de atividades para detectar comportamentos anômalos

- Manter os sistemas e agentes de IA atualizados com os patches de segurança mais recentes

Checklist prático

- Revise as políticas de segurança de entrada de dados

- Configure alertas de segurança no GitHub

- Realize auditorias regulares em seus sistemas de IA

Perguntas frequentes

O que é um prompt injection?

É um ataque onde comandos maliciosos são inseridos em entradas de dados para manipular sistemas de IA.

Como posso identificar um ataque?

Fique atento a comportamentos anômalos e solicitações de dados incomuns.

Quais medidas de proteção devo adotar?

Implemente validação de entradas, monitore atividades e mantenha sistemas atualizados.

Proteja sua empresa com a LC Sec

Fale com nossos especialistas para garantir que sua empresa esteja protegida contra vulnerabilidades como o prompt injection.

Conheça: Pentest, Threat Intelligence com IA, Conscientização, SGSI, Plano Diretor de Segurança e Auditoria Interna. lcsec.io

Receba as principais notícias de cibersegurança

Inscreva-se em nossa newsletter e receba artigos, alertas de vulnerabilidades e tendências diretamente no seu email.